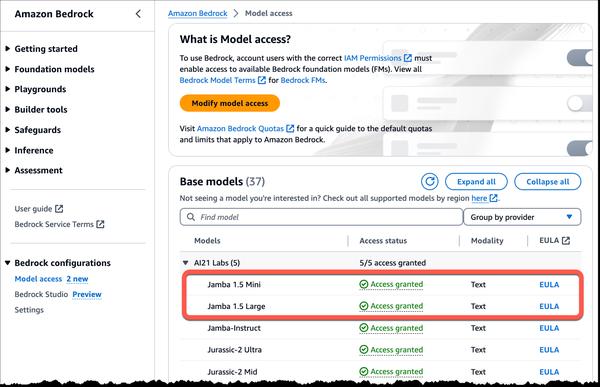

AWSとAI21 Labsは、Amazon BedrockでAI21 Labsの強力な新しい大規模言語モデル(LLM)であるJamba 1.5ファミリーが利用可能になったことを発表しました。これらのモデルは、幅広いアプリケーションで速度、効率性、パフォーマンスを提供する、長いコンテキスト言語機能における大幅な進歩を表しています。

Jamba 1.5モデルは、Transformerモデルアーキテクチャと構造化状態空間モデル(SSM)テクノロジーを組み合わせた独自のハイブリッドアーキテクチャを活用しています。この革新的なアプローチにより、Jamba 1.5モデルは、従来のTransformerモデルの高性能特性を維持しながら、最大256Kトークンの長いコンテキストウィンドウを処理できます。

Jamba 1.5モデルの主な強みは次のとおりです。

* 長いコンテキスト処理:256Kトークンのコンテキスト長により、Jamba 1.5モデルは、長いドキュメントの要約と分析、およびエージェンシーとRAGワークフローなど、エンタープライズアプリケーションの品質を向上させることができます。

* 多言語:英語、スペイン語、フランス語、ポルトガル語、イタリア語、オランダ語、ドイツ語、アラビア語、ヘブライ語をサポートしています。

* 開発者向け:構造化JSON出力、関数呼び出しのネイティブサポート、およびドキュメントオブジェクトをダイジェストする機能。

* 速度と効率:AI21はJamba 1.5モデルのパフォーマンスを測定し、モデルが同等のサイズの他のモデルよりも長いコンテキストで最大2.5倍高速な推論を示すことを共有しました。

Jamba 1.5モデルは、ペアになったドキュメント分析、コンプライアンス分析、長いドキュメントの質問応答などのユースケースに最適です。複数のソースの情報と簡単に比較したり、文章が特定のガイドラインを満たしているかどうかを確認したり、非常に長く複雑なドキュメントを処理したりできます。

AI21 LabsのJamba 1.5モデルファミリーは、本日より、米国東部(バージニア北部)AWSリージョンにあるAmazon Bedrockで一般提供が開始されました。

これらのモデルは、言語処理の分野における重要な前進を表していると信じています。長いコンテキストを処理できるため、開発者や企業にとって幅広い新しい可能性が開かれます。これらのモデルを使用して、どのような革新的なアプリケーションが開発されるのか、楽しみにしています。